NeoCAM AI 相机助力停车场管理升级

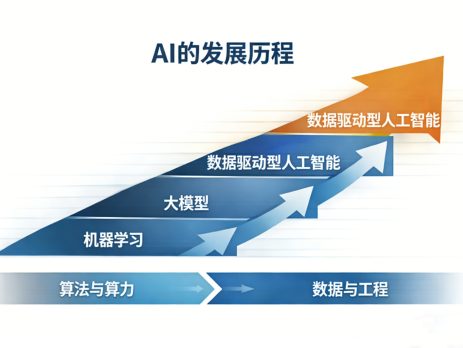

在城市化进程不断加速的今天,停车场景早已不再是简单的“水泥盒子”。它变成了城市交通的毛细血管,也是检验智慧城市运营效率的试金石。无论是商业综合体的潮汐客流,还是老旧小区的夜间车位紧张,停车场管理者面临的挑战正变得越来越复杂:如何保证复杂环境下的车牌识别率?如何让普通的监控摄像头具备“思考”能力? 传统的停车管理方案大多依赖像素较低的普通相机,在面对雨雾、强逆光或夜间微光时,识别率往往大打折扣 。而在AI技术深度渗透的今天,行业的需求已经发生了根本性的转变:我们需要的不仅是一双能“看清”的眼睛,更是一个能在边缘侧“看懂”并实时反应的大脑。 1. 停车场痛点 如果你曾在小区的昏暗地库入口遇到过闸杆迟迟不抬,或者在暴雨天因车牌识别错误而倒车,你就亲身体验了传统停车系统的“盲区”。 根据最新的行业观察,当前停车场管理存在三大核心痛点: 恶劣环境下的“失明”:雨雾天气、夜间极暗环境、强光逆光都会导致传统相机成像模糊、信噪比下降。为了补光,很多停车场不得不安装大功率爆闪灯,这不仅造成了光污染,也对车主驾驶造成了一定的安全隐患。 识别角度的“局限”:传统相机视角有限,在弯道或短纵深车道,容易出现漏拍。特别是在极限跟车(如40cm车距)场景下,很难将车头牌与车尾牌正确关联,甚至无法捕捉挂车等特殊车型,给“套牌逃费”和“跟车逃费”留下了可乘之机 。 数据价值的“单一”:大多数系统只能输出“车牌号”和“进出时间”,无法对场内的事件进行实时分析,例如车辆违停、通道拥堵、剐蹭事故追溯,甚至无法为车主提供空余车位的精准导航 。 2. 边缘计算与算法自定义 要破解这些痛点,单纯提升镜头、传感器等硬件成像能力,已经走到了物理瓶颈期。真正的破局点在于:当物理成像到达极限后,让“算法”来接管。 思林杰的NeoCAM AI相机的核心逻辑正在于此:当物理成像遭遇环境极限时,我们选择用算法来破局。因此,我们不仅提供稳定的图像采集能力,更通过内置的强劲算力与开放生态,让相机具备“在传统难以看清的场景下,依靠算法‘算’得清”的能力——无论是雨雾造成的对比度下降,还是逆光导致的局部过暗,都能通过实时图像增强算法进行修复与还原。这正是解决恶劣环境下“失明”问题的关键所在。 强劲的 edge 算力:让算法“跑得动” 再好的算法,也需要足够的算力来承载。NeoCAM内置3.0 TOPS的AI算力,完全能够支撑车牌识别、人脸检测、车辆属性分析等复杂模型的实时推理,确保从图像增强到结构化识别的全流程都在相机端完成,无需依赖云端。 可靠的硬件平台:让算法稳定运行 NeoCAM 基于 Rockchip RV1126B 四核 Cortex-A53 处理器,内置 3.0 Tops NPU,高效承载车牌识别、图像增强等 AI 模型的实时推理。其新一代硬件 ISP 融合 AI-ISP 技术,支持 HDR、3DNR、去雾等功能,确保雨雾、逆光、极暗环境下仍能输出高质量图像。硬件采用 38 板标准结构,支持 POE 供电,工作温度 -10℃ 至 50℃,网口 4KV 雷击防护,并内置看门狗与固件加密,保障 7×24 小时稳定运行。 灵活的SDK:让算法按需部署:这是NeoCAM区别于固定功能的成品相机的核心优势。许多停车场方案商拥有自研的、针对特定地区车牌(如新能源绿牌、港澳双牌)的优化算法,但往往被硬件绑定所困扰。NeoCAM 提供完整的SDK和开发指导,允许客户将自己的算法直接移植到相机中。这意味着,无论是针对停车场车辆属性分析(车牌、车型颜色等)的定制化需求,还是特定厂区的违章行为分析,开发者都能在NeoCAM的硬件平台上实现算法的快速部署与迭代。 3. 未来停车场的三大演进方向 结合行业趋势,未来的智慧停车将呈现以下三个方向: 端-边-云协同治理:前端相机负责“采”和“认”,边缘侧主机负责多源数据融合(如雷达与视觉融合),云端负责全局调度和大数据分析,如预测周末的车流高峰时段,提前调配资源 。 从“车”到“场”的全域智能:AI的监控范围将不再局限于出入口闸杆。车辆逆行、消防通道占用、危化品车辆违停、甚至停车场内的烟火预警,都将由同一套视觉系统接管,实现从“人防”到“智防”的转变 。 平台化与开放化:硬件趋向标准化,软件趋向个性化。像NeoCAM这样的平台型产品,将成为AI算法公司的“沃土”。硬件厂商专注于做好供电、散热、图像采集和基础算力,而百花齐放的算法应用则交给更懂场景的专业开发者 。 4. 结语 停车场虽小,却是窥见未来城市智慧密度的一个窗口。在这个窗口里,我们看到的不仅是技术的迭代,更是一种协作模式的转变。 NeoCAM AI相机正是为了迎接这一转变而设计。它不仅以强大的RV1126B核心和精细的画质处理能力,为客户提供可靠的算法运行载体;更通过开放的平台与完善的开发支持,赋能开发者将自有算法快速落地,“看懂”并“解决”更深层次的业务痛点。 如果你正在寻找一款能真正承载你自有算法的硬件平台,或者希望为你的停车场解决方案寻找一个稳定、高性能的算力载体,欢迎联系我们(官方邮件:info@smartgaint.com)获取《NeoCAM AI相机 开发指南》与硬件规格书。